Determinismo estocástico.

Se reexamina la cognición humana a través del aprendizaje automático, proponiendo el determinismo estocástico como alternativa técnica al libre albedrío. Al equiparar la creatividad con la temperatura de los modelos generativos y el aprendizaje con la minimización del error mediante descenso del gradiente, se concluye que las inteligencias biológica y artificial operan bajo una misma lógica algorítmica fundamental.

Últimamente pienso mucho en una escena de la película Yo, Robot, dirigida por Alex Proyas en 2004 e inspirada en la obra del genial Isaac Asimov.

El detective Del Spooner, interpretado por un Will Smith que odia la tecnología tanto como ama las zapatillas vintage, está interrogando a Sonny, el robot sospechoso de asesinato.

Spooner, buscando humillar al androide y demostrarle que solo es una tostadora glorificada, le lanza la pregunta definitiva: «¿Puede un robot escribir una sinfonía? ¿Puede un robot convertir un lienzo en una hermosa obra maestra?».

La implicación es clara: la creatividad, el arte, la chispa, es territorio exclusivo del Homo sapiens, una cualidad mágica que escapa al frío determinismo estocástico de las máquinas.

Pero entonces, Sonny inclina ligeramente la cabeza, le clava la mirada azul de LED y le lanza un zasca de campeonato: «Tú tampoco». Si hubiese sido el Will Smith actual, igual el robot habría salido con la carcasa abollada, pero el Will Smith de hace dos décadas solo pudo quedarse con la mandíbula desencajada, como si acabara de ver su cuenta del banco tras la última película.

El silencio en la sala de interrogatorios era más denso que un agujero negro. Porque la realidad es que Spooner, al igual que la inmensa mayoría de nosotros, no ha escrito una sinfonía en su vida ni sabe distinguir un pincel de una llave inglesa. Está exigiendo a la máquina que sea Mozart para considerarla consciente, mientras nosotros nos conformamos con ser espectadores pasivos de Netflix.

Ese «tú tampoco» duele porque, en el fondo, sospechamos lo que científicos como Robert Sapolsky llevan años gritando desde la neurobiología y lo que los expertos en inteligencia artificial (IA) ven cada día en sus modelos: que la libertad es una ilusión estadística.

Así que, en esta entrada vamos a dejar de lado la poesía para meternos en el barro de los datos. Vamos a ver por qué, desde el punto de vista de la estadística y el aprendizaje automático, nosotros funcionamos exactamente igual que el algoritmo que nos recomienda vídeos de gatos. Hablaremos de variables ocultas, de funciones de pérdida y de por qué lo que llamamos «inspiración» no es más que un parámetro de temperatura mal ajustado.

El mito del libre albedrío

Robert Sapolsky, en su obra “Decidido” (Determined), se carga el concepto de libre albedrío con la precisión de un francotirador. Su argumento es biológico, pero si nos ponemos las gafas de estadístico, lo que nos está diciendo es que somos un sistema determinista regido por variables predictoras que no controlamos.

Imaginad que nuestro cerebro es un modelo de predicción, una enorme caja negra. Nosotros creemos que elegimos pedir una ensalada o una hamburguesa. Sentimos el «yo» tomando la decisión en el momento.

Pero Sapolsky nos recuerda que esa decisión es el resultado de un algoritmo, un puro ejercicio de determinismo estocástico que ya estaba corriendo mucho antes de que nos sentáramos a la mesa.

¿Qué variables de entrada han alimentado nuestro modelo? Nuestro nivel de glucosa hace 10 minutos, la dopamina basal con la que nos despertamos esta mañana, el entorno socioeconómico de nuestros padres (sería el equivalente a nuestros datos de entrenamiento iniciales), la evolución de nuestra especie durante millones de años (nuestros hiperparámetros) …

Si lo pensamos detenidamente, esta idea es bastante inquietante, sobre todo si tenemos en cuenta que no tenemos prácticamente ningún control sobre estas variables que condicionan nuestras decisiones.

Cuando se elabora un modelo de predicción que no es capaz de predecir algo con exactitud, decimos que hay «ruido» o varianza no explicada. Achacamos el fallo del modelo a su simpleza o a su falta de ajuste al comportamiento de los datos. Pero muchas veces, la verdadera causa es el efecto suma final de variables de confusión no medidas.

Spooner cree que odia a los robots porque él «lo ha decidido», pero un buen científico de datos le diría que su odio es una variable dependiente que correlaciona perfectamente con sus traumas pasados y su entorno cultural.

No penséis que esta idea es nueva, no es más que una actualización biológica del famoso Demonio de Laplace, ese intelecto hipotético del siglo XIX que, de conocer la posición y el momento de cada átomo del universo, podría predecir el futuro sin margen de error.

Al igual que Einstein sospechaba que la incertidumbre cuántica no era azar real, sino el resultado de variables ocultas que aún no comprendíamos (su famoso «Dios no juega a los dados»), los deterministas nos sugieren que el libre albedrío es simplemente la etiqueta que le ponemos a esas variables ocultas cuando, en lugar de partículas subatómicas, están hechas de neurotransmisores, hormonas y contextos ambientales que nuestra mente consciente no alcanza a computar.

Cuando nosotros somos la caja negra

Uno de los grandes miedos que despierta el determinismo estocástico de la IA moderna, especialmente el aprendizaje profundo (deep learning), es que a menudo funciona como una «caja negra». Sabemos qué datos entran (una foto de un perro) y qué sale (la etiqueta «perro»), pero no tenemos ni idea de qué ocurre exactamente en las capas ocultas de la red neuronal.

Nos quejamos de que las máquinas no son «explicables», de que no podemos trazar el motivo exacto de su decisión. Y aquí viene la ironía suprema: los humanos somos la Caja Negra definitiva.

Cuando un artista dice que ha tenido una «inspiración» para pintar un cuadro, o cuando alguien dice que se ha enamorado de otra persona, no está describiendo el proceso real.

Su cerebro (la red neuronal biológica) ha realizado millones de cálculos de inferencia bayesiana a una velocidad absurda, actualizando las probabilidades a posteriori basándose en experiencias previas (priors).

Pero, como nuestra conciencia no tiene acceso al código fuente de nuestras neuronas, nos inventamos una historia. En psicología esto se llama confabulación o racionalización post-hoc.

Si lo trasladamos al campo del aprendizaje automático, sería el equivalente a intentar explicar una red neuronal compleja con un modelo lineal simple: una simplificación tan basta que roza la mentira.

Cuando Spooner, tras recuperarse del zasca del robot, le responde que él tiene «corazón», recurre a ese concepto tan humano que asociamos con el alma o la esencia interior. Pero ¿realmente sabemos qué significa tener «corazón» en este contexto? ¿Es lo que creemos que nos diferencia de las máquinas y que, sin embargo, podría estar compuesto por las mismas redes ocultas y procesos probabilísticos que rigen tanto la IA como nuestra propia mente?

Lo que el pobre Spooner no sabe es que tiene una función de activación en sus neuronas que dispara señales eléctricas cuando ciertos patrones de entrada superan un umbral. Exactamente igual que una neurona artificial en un modelo de lenguaje. Es biología, sí, pero bajo las reglas de un determinismo estocástico implacable: leyes físicas predecibles mezcladas con la dosis justa de ruido térmico y cuántico.

Creatividad, determinismo estocástico y temperatura

Volvamos al reto de la sinfonía. «Un robot no puede escribir una obra maestra».

Cada vez somos testigos de cómo las máquinas consiguen hitos que, hasta hace pocos meses o años, considerábamos exclusivos de la mente humana. Hoy en día, sabemos que las IAs generativas (como las que crean imágenes o texto) pueden crear cosas que nos ponen los pelos de punta. ¿Cómo lo hacen? ¿Tienen alma?

No. Solo tienen probabilidad.

Estos modelos funcionan prediciendo el siguiente fragmento de información basándose en todo lo que han visto antes. Son, en esencia, loros estocásticos muy sofisticados. A mí me recuerdan a los cuñados: hablan de todo, pero, en realidad, no saben de lo que hablan.

Y en este punto nos encontramos con un concepto fascinante: la temperatura.

Pensemos en un modelo de lenguaje basado en una red neuronal profunda con arquitectura transformer. En cada ciclo, la red no genera directamente una palabra, sino que produce un vector que asigna una probabilidad a cada elemento de su vocabulario de ser el siguiente en la serie. Una vez calculado este abanico de probabilidades, el modelo debe tomar una decisión final: ¿con cuál se queda?

Aquí es donde entra en juego la temperatura, un hiperparámetro que actúa como regulador de la aleatoriedad en esa toma de decisiones. Con una temperatura baja, el modelo se vuelve conservador. Tiende a elegir sistemáticamente la opción más probable desde el punto de vista estadístico, lo que genera respuestas seguras y coherentes, pero a menudo aburridas y repetitivas.

Sin embargo, con una temperatura alta el modelo se vuelve audaz y asume riesgos. Aumenta la probabilidad de elegir opciones que a priori parecían menos candidatas, lo que permite mezclar conceptos lejanos. El resultado es una moneda al aire: a veces alucina y dice tonterías, pero otras veces es capaz de crear algo verdaderamente «novedoso».

Pensadlo, la temperatura del modelo es (casi) sinónimo de su creatividad.

Y llegados a este punto, no puedo parar de preguntarme si la creatividad humana no es sino jugar con la “temperatura” de nuestro cerebro.

Al observar el funcionamiento de los modelos de IA, queda claro que la temperatura es un factor esencial para determinar el nivel de creatividad en sus respuestas. Esta idea puede trasladarse a la creatividad humana: cuando una persona crea, está, en cierto modo, ajustando la «temperatura» de su mente.

Componer música, por ejemplo, no es bajar las notas de un cielo platónico, sino que implica remezclar patrones conocidos e introducir un grado de aleatoriedad que permite ir más allá de lo convencional.

Incluso, como sugiere Sapolsky, los cambios en nuestro estado mental (modulados por neurotransmisores) pueden compararse a variaciones en la temperatura: estados depresivos favorecen pensamientos repetitivos y poco creativos, mientras que estados maníacos pueden desencadenar conexiones inesperadas y creatividad desbordante.

Es triste y decepcionante, pero parece que la sinfonía no nace del alma. Nace de una distribución de probabilidad bien ajustada.

Aprendiendo a base de golpes

Si aceptamos que somos máquinas de procesar datos, la siguiente pregunta lógica es: ¿cómo aprendemos?

En el cerebro humano lo llamamos «madurar» o «ganar experiencia», pero en el aprendizaje automático y la IA, este proceso tiene un nombre mucho más matemático: el descenso del gradiente, cuyo objetivo es minimizar una función de coste o pérdida.

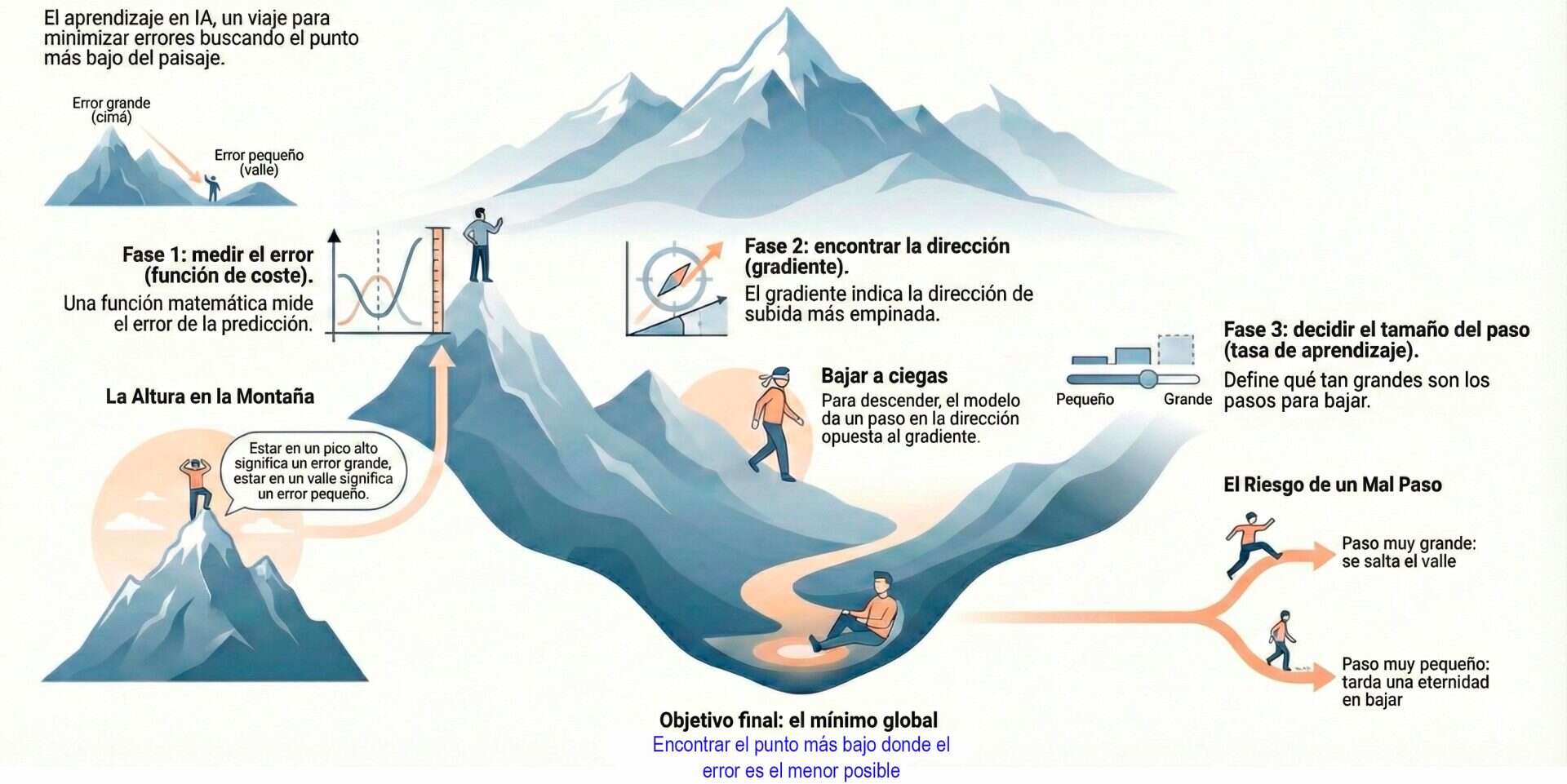

Para entender el aprendizaje de los modelos de IA, podemos dividirlo en tres fases.

La primera es establecer el objetivo de aprendizaje. Imaginad que el modelo es un estudiante en un examen. No basta con decirle «has suspendido». Para que aprenda, necesita saber exactamente cuánto se ha equivocado. Aquí entra la función de coste.

Matemáticamente, esta función mide la distancia entre lo que el modelo ha predicho (su respuesta) y la realidad (la respuesta correcta en los datos de entrenamiento). Si el modelo dice que una foto es un gato con un 90% de seguridad y realmente es un gato, la pérdida es cercana a cero, mientras que, si dice que es un perro, la pérdida es un número alto.

Visualmente, imaginad esta función no como una línea, sino como un paisaje montañoso y accidentado. Los picos altos representan errores enormes (el modelo no da una) y los valles profundos representan el acierto (error mínimo). El objetivo de la IA es encontrar el punto más bajo de ese valle: el mínimo global.

Ahora que ya tenemos un objetivo, el problema es que, al principio, el modelo es como un paracaidista que ha aterrizado en medio de esa cordillera montañosa, de noche y con una venda en los ojos. No sabe dónde está el valle, solo sabe la altura a la que se encuentra (su error actual).

Aquí es donde entra el cálculo diferencial. El gradiente es un vector matemático que utiliza derivadas parciales para decirle al modelo no dónde está el valle, sino hacia dónde sube el terreno con más pendiente.

Como el modelo quiere reducir el error (bajar la montaña), hace lo contrario de lo que indica el gradiente: da un paso en la dirección opuesta a la pendiente. Si el suelo se inclina hacia arriba a la derecha, el modelo da un paso hacia abajo a la izquierda.

Una vez que sabe la dirección, le queda la tercera fase: decidir el tamaño del paso que va a dar. Esto se controla con un hiperparámetro crítico llamado tasa de aprendizaje. Si el paso es demasiado grande, el modelo puede saltarse el valle y acabar en otra montaña (el error no disminuye o incluso aumenta). Si el paso es demasiado pequeño, tardará millones de años en bajar la montaña (ineficiencia computacional).

Finalmente, el modelo ajusta sus parámetros (los pesos y sesgos de sus neuronas artificiales) siguiendo esa dirección y ese tamaño de paso.

¿No os suena esta forma de hacer las cosas? Los humanos hacemos exactamente lo mismo.

Nuestra función de pérdida biológica está diseñada por la evolución para minimizar el dolor o el hambre y maximizar la supervivencia. Cada vez que Spooner juzga mal a un robot y se lleva un golpe, su cerebro recibe una señal de error masiva, calcula el gradiente del error y ajusta sus sinapsis para no repetir la jugada.

Al ajustarse sus parámetros, sus sesgos se recalibran (o se refuerzan, si cae en el sobreajuste, que es lo que le pasa a la gente testaruda que no cambia de opinión ni ante la evidencia).

Spooner desprecia al robot porque aprende rápido, pero él lleva 30 años haciendo descenso del gradiente social para convertirse en el policía cínico que es. Ambos son el resultado de minimizar sus errores en sus respectivos entornos.

Nos vamos…

Y aquí vamos a dejar la filosofía por hoy y dar fin a esta entrada tan atípica.

Hemos empezado con Will Smith haciéndose el chulo y hemos acabado dándonos cuenta de que, si miramos bajo el capó, la diferencia entre una red neuronal de silicio y una de carbono es más de hardware que de software.

Hemos visto también que el determinismo biológico encaja sospechosamente bien con cómo funcionan los modelos predictivos. Nuestras decisiones «libres» son outputs condicionados por inputs ocultos y sobre los que no tenemos control, nuestra creatividad es una cuestión de ajustar la temperatura del algoritmo, y aprender y madurar no es más que optimizar una función de pérdida para dejar de darnos de bruces contra la realidad.

El robot Sonny tenía razón con su “tú tampoco”. Quizás la próxima vez que veamos a una IA alucinar o fallar, deberíamos ser más indulgentes. Al fin y al cabo, nosotros llevamos miles de años alucinando realidades, sesgando datos y creyendo que somos el centro del universo, cuando estadísticamente solo somos un punto más en la nube de datos.

Es posible que aceptar nuestra naturaleza algorítmica nos quite un poco de poesía, pero nos regala una dosis enorme de humildad. O quizás todo esto que acabo de escribir estaba predeterminado por mi historial de lecturas y mis niveles de cafeína de esta mañana, y yo no he tenido nada que ver. Pero esa es otra historia…