Herramientas de inteligencia artificial.

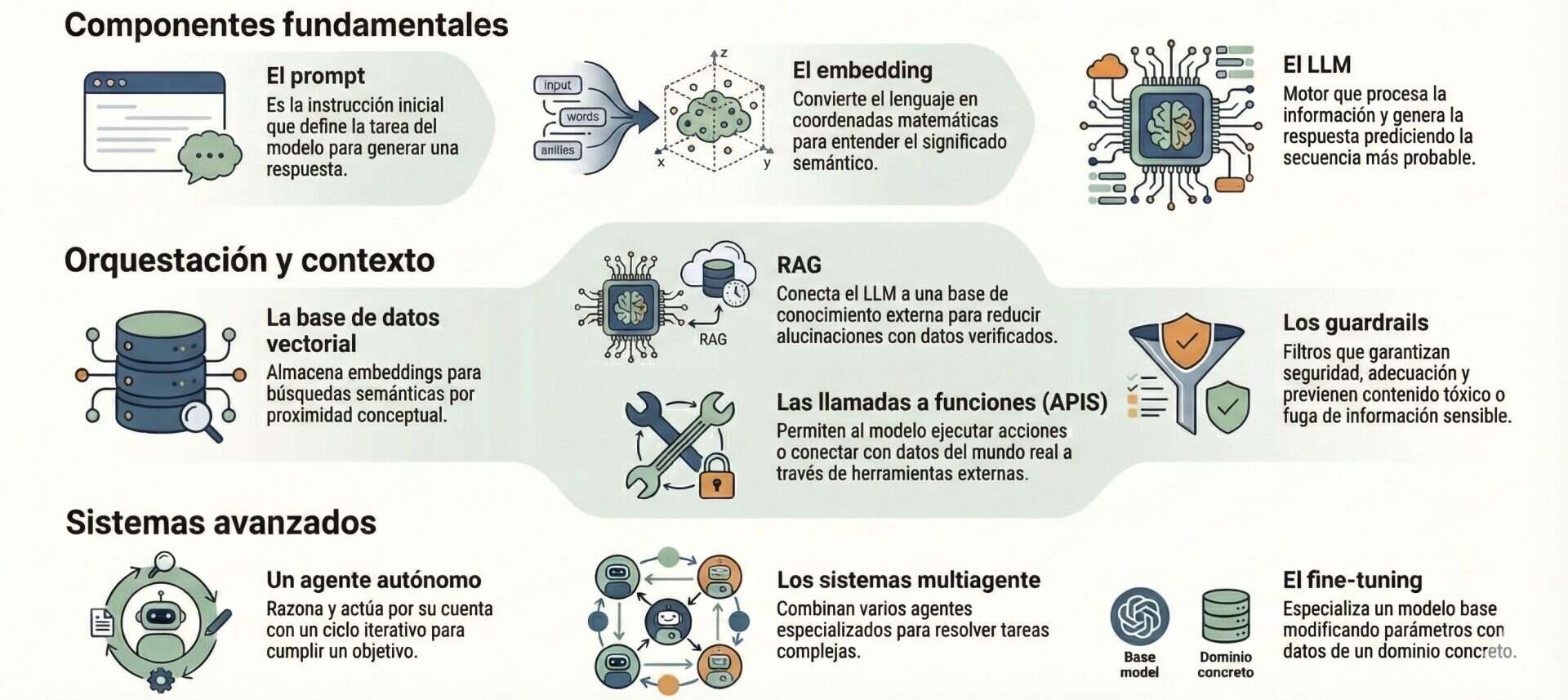

Las herramientas de inteligencia artificial actuales operan sobre arquitecturas modulares complejas que trascienden al modelo del lenguaje básico. Se revisan los componentes técnicos esenciales para su funcionamiento coordinado, comenzando por el uso de embeddings y bases de datos vectoriales como fundamento para la búsqueda semántica y la implementación de RAG, así como mecanismos de orquestación avanzada y el desarrollo de agentes autónomos y procesos de fine-tuning para la especialización en dominios específicos.

La noche del 29 de mayo de 1913, el Théâtre des Champs-Élysées de París se convirtió en el escenario de una batalla campal. No, no era una revolución política, sino el estreno de La consagración de la primavera de Ígor Stravinski. La música era tan radical, tan llena de disonancias y ritmos «bárbaros», que la mitad del público empezó a gritar insultos, mientras la otra mitad gritaba para pedir silencio.

Los bailarines, incapaces de oír la orquesta entre el estruendo de los abucheos y los puñetazos en el patio de butacas, tuvieron que seguir los pasos contando mentalmente mientras el coreógrafo les golpeaba el ritmo desde las bambalinas. Aquello no parecía música; parecía ruido puro, caos y anarquía auditiva.

Y es que, en muchas ocasiones, las vanguardias tienen que sufrir la incomprensión de su público. Es algo parecido a lo que le ocurre a la ciencia cada vez que experimenta nuevos avances. Cuando nos enfrentamos a nuevas tecnologías, el «ruido» de la novedad puede impedirnos escuchar la melodía subyacente. Por poner un ejemplo, intentar entender cómo funciona un algoritmo complejo o descifrar la validez de un estudio masivo de datos sin la metodología adecuada es como intentar encontrar el leitmotiv de un fagot mientras el señor de la butaca de al lado te está gritando al oído.

Pero hoy no vamos a hablar de teatros, sino de los términos relacionados con las herramientas de inteligencia artificial (IA). El caos actual de algoritmos, datos y siglas incomprensibles se parece mucho más al estruendo de un servicio de cenas en hora punta: platos rotos, órdenes a gritos y vapor por todas partes.

Así que vamos a guardar los prismáticos de ópera y ponernos el gorro de chef para entrar en la cocina más ruidosa del momento. Bienvenidos a la cocina de la IA, donde las siglas vuelan como platos rotos. Pero tranquilos, que no cunda el pánico: entre tanto ruido y ollas a presión, vamos a poner un poco de orden para encontrar la receta oculta en este desastre. Afilad los cuchillos, que entramos.

Pesadilla en la cocina

Entrar en una conversación sobre tecnología de IA actual es como colarse en una cocina profesional en pleno servicio de cena: hay bullicio por todas partes, alguien grita «¡RAG!», otro responde «¡embeddings!», y un tercero parece estar peleándose con un «agente». Todo el mundo asume que sabes dónde está la sal y qué leches es un «guardrail«, pero la realidad es que la mayoría no sabe ni encender el horno.

Para poner orden en este manicomio culinario, vamos a olvidarnos de cajas negras y vamos a dibujar el plano de una cocina bien organizada. Aquí lo que importa es dónde se guardan las cosas, dónde se pica la cebolla y quién manda en los fogones. Esta estructura nos permitirá diseccionar cualquier «plato» de IA que nos sirvan.

La despensa y el personal básico

Antes de encender un solo fuego, necesitamos saber con qué contamos. En el almacén de nuestra IA tenemos los elementos «atómicos», esos que no se pueden dividir más sin romper la física de la cocina.

Uno de los más famosos es el prompt o instrucción (si me lo permitís, en esta entrada abusaré de los términos en inglés, mucho más utilizados incluso por los que no hablamos la jerga de Shakespeare). El prompt no tiene misterio; es, simplemente, la hoja de pedido con las instrucciones que le pasamos a la IA. Para entendernos, es como la comanda que le pasamos al cocinero.

En el entorno de la biomedicina, la especificidad de la comanda es vital. No es lo mismo gritar «¡marchando una de dolor!» que escribir: «actúa como médico y resume la utilidad de la semaglutida para la insuficiencia cardíaca en pacientes sin diabetes».

El prompt es un elemento puramente reactivo: si cambias una palabra del pedido, el plato que sale es completamente distinto. De todas formas, tenéis que saber también que, al igual que los buenos cocineros, una misma herramienta de IA puede hacer un plato ligeramente diferente ante la misma comanda. Esto es así por la aleatoriedad implícita en el funcionamiento de los modelos: aunque las respuestas deberían ser similares desde el punto de vista semántico, no serán exactamente iguales cada vez.

El segundo elemento indispensable en una buena cocina de IA es el embedding. Aquí entra la nariz del cocinero, capaz de reconocer los distintos perfiles de sabor de sus platos. ¿Cómo sabe una máquina que «infarto de miocardio» y «ataque al corazón» maridan igual? Gracias a los embeddings.

Hablando de una forma más técnica, un modelo de embedding transforma cada fragmento del texto que recibe en un vector, es decir, una serie de coordenadas en un espacio matemático de muchas dimensiones. Imaginad un mapa de sabores infinito donde no solo existen lo apetitoso y lo incomible, sino cientos de ejes distintos: uno mide la ‘dulzura’, otro la ‘acidez’, otro la ‘textura’, y así hasta mil características invisibles. En este mapa geométrico multidimensional, el modelo de embedding coloca cada fragmento en una ubicación exacta basándose en su uso y contexto, de modo que los fragmentos con significados parecidos acaban aterrizando físicamente cerca unos de otros.

En resumen, en los embeddings se convierte la ambigüedad del lenguaje en coordenadas matemáticas precisas de un espacio vectorial multidimensional. Al asignar a cada ingrediente una huella digital numérica basada en sus cualidades, la IA puede ignorar la ortografía y centrarse en la semántica. Así es como logra detectar que ingredientes con etiquetas muy distintas, como ‘cefalea’ y ‘dolor de cabeza’, pertenecen, en realidad, a la misma familia de sabores.

Y, en tercer lugar, dentro de la despensa de esta cocina, tenemos a nuestro chef estrella: el modelo grande de lenguaje (LLM).

Si nos ponemos la bata por un segundo (encima del delantal), un LLM no es más que una red neuronal gigantesca entrenada con terabytes de texto. Su funcionamiento técnico se basa en la probabilidad: ha leído tantas recetas, libros y conversaciones que es capaz de predecir cuál es la siguiente palabra (token, en realidad) más lógica en una secuencia.

Imaginad a un cocinero que, aunque nunca haya probado un plato, sabe estadísticamente que después de ‘cascar huevos’ y ‘añadir sal’, lo que viene con un 99% de probabilidad es ‘batir’ y no ‘meter en el lavavajillas’. No razona como un humano, pero imita el razonamiento tan bien que da el pego.

El LLM es el motor culinario, el único con la capacidad de leer la comanda, entender los perfiles de sabor y ejecutar la técnica para sacar el plato adelante. Sin él, la cocina está vacía.

En la actualidad, hay disponibles un montón de chefs, algunos con su especialidad en determinado tipo de cocina. Quizás el más famoso y versátil sea GPT (OpenAI), con Gemini (Google) pisándole los talones (o pasando por encima). Otros muy conocidos son Claude (Anthropic), famoso por su capacidad para escribir código, o Llama (Meta) y Mistral (MistralAI), los chefs de código abierto, por mencionar algunos.

También hay chefs que te dejan ver sus trucos y que puedes llevarte a cocinar a tu propia casa, sin depender de nadie. O sea, que los puedes descargar gratis y utilizar en tu propio ordenador, si tienes la potencia de cómputo suficiente.

La mise en place

Como ya dijo el legendario chef Auguste Escoffier, la puesta en su lugar de todos los ingredientes y utensilios es el orden sagrado de la organización profesional en una buena cocina.

No es solo picar cebolla. Hay que leer la receta, reunir los utensilios necesarios, pesar los ingredientes, lavar, pelar, cortar y colocar cada cosa en boles o recipientes listos para usar… El objetivo es evitar el caos. Si tienes una buena mise en place, cuando estás cocinando no tienes que parar para buscar la sal o pelar una patata; solo tienes que ejecutar, lo que permite velocidad y precisión, especialmente bajo presión.

Pues algo parecido ocurre cuando usamos herramientas de IA: tener los datos organizados y las herramientas listas hace posible que el LLM pueda cocinar la respuesta sin errores. En esta zona de nuestra cocina de IA tenemos cuatro elementos fundamentales.

El primero del que vamos a hablar es la base de datos vectorial, que funciona como un especiero bien organizado. Si tenemos millones de vectores en el espacio del embedding (esos perfiles de sabor que mencionamos antes), no podemos tenerlos tirados en un cajón. Necesitamos un sistema de almacenamiento optimizado para búsqueda semántica.

Aquí es donde la geometría se une a la gastronomía. A diferencia de una base de datos clásica (pensad en la típica hoja de Excel) que busca coincidencias exactas (si buscamos ‘sal’, el sistema fallará si lo tiene etiquetado como ‘cloruro sódico’), las bases vectoriales calculan distancias.

Cada concepto procesado por el modelo de embedding se convierte en un vector dentro de un espacio multidimensional. En este espacio, se utilizan algoritmos matemáticos (como la similitud del coseno, la distancia euclídea o la búsqueda de los k vecinos más cercanos) para medir cuán próximos están dos vectores. Esto es lo que permite encontrar instantáneamente el ingrediente que mejor marida conceptualmente con tu pedido en milisegundos, sin necesidad de que las palabras coincidan letra por letra.

Ahora vamos a pensar en una situación catastrófica (aunque improbable). Imaginad un cocinero que tiene mucha imaginación y poca memoria y se inventa una paella con chorizo (las temidas alucinaciones). Para evitar algo así, podemos obligarle a no cocinar de memoria, sino a consultar un libro de recetas de confianza antes de encender el fuego. Es una técnica de orquestación pura: busca, lee, y luego cocina basándose en lo que ha leído y en sus conocimientos y experiencia previa.

¿Y qué tiene que ver esto con la IA? Pensadlo de la siguiente manera. Un buen cocinero tiene una intuición general sobre cómo preparar casi cualquier cosa (su entrenamiento base), pero cuando entra en un restaurante de alta cocina especializado no se le permite improvisar. Cada restaurante tiene sus recetas precisas desarrolladas con la experiencia, donde se detalla que la salsa se reduce exactamente 12 minutos, no 10 ni 15, por poner un ejemplo bastante tonto.

Pues bien, un modelo de IA puede saber mucho de medicina general porque «leyó» todo internet durante su entrenamiento, pero no conoce los protocolos específicos de tu hospital ni los resultados del análisis que le hicieron a ese paciente concreto ayer por la tarde. Aquí es donde entra en acción otro elemento de la mise en place de la cocina: la generación aumentada por recuperación, RAG, por sus siglas en inglés.

Desde un punto de vista técnico, el RAG resuelve dos limitaciones críticas de los LLMs: la alucinación y la obsolescencia del conocimiento. Los modelos tienen un conocimiento «congelado» en sus parámetros (lo que aprendieron cuando fueron entrenados). El RAG permite conectar ese cerebro congelado a una base de datos viva, un banco de conocimiento almacenado en una base de datos vectorial. El proceso técnico sigue un flujo en tres etapas.

Cuando el usuario hace una consulta (el prompt), esta se introduce en el espacio del embedding y el sistema busca en la base de datos vectorial los fragmentos de información que son más similares desde el punto de vista semántico, recuperando así la información más relevante en relación con la consulta efectuada al modelo.

Estos fragmentos recuperados son «inyectados» dentro del prompt (la consulta se ve aumentada) y se pasan al modelo de manera conjunta. Es como decirle a la IA: «Usando SOLO la siguiente información de contexto [aquí se inserta la información recuperada], responde a la pregunta [aquí va el prompt del usuario]».

Con esto, al LLM solo le queda generar la respuesta. Al tener la respuesta correcta delante de sus narices, dentro de la ventana de contexto, la probabilidad de error o invención cae drásticamente, logrando una respuesta anclada en la evidencia encontrada en su base de conocimiento.

Sin RAG, el chef intentaría adivinar el plato basándose en lo que sabe «en general». Con RAG, le obligamos a abrir el archivador del hospital, sacar la ficha del paciente y el protocolo vigente y cocinar la respuesta usando exclusivamente esos ingredientes verificados. Convertimos un modelo generalista en el especialista definitivo de nuestro ámbito específico.

De todas formas, incluso con una buena base de datos vectorial y una buena base de conocimientos, siempre habrá cosas que el chef no sabrá hacer por sí solo, como saber qué tiempo hace fuera, lo que puede influir en el tipo de platos que le pidan los comensales en la cena. Aquí es donde usa herramientas externas, como un termómetro digital o la aplicación meteorológica de su móvil.

De esta manera, el chef llama a la herramienta, obtiene el dato real (no inventado) y sigue cocinando. En el argot técnico de la IA, a esto se le llama function calling, una llamada a funciones que saben cómo ejecutar la herramienta.

La fundamentales serían las APIs de conexión al mundo real, que permiten actualizar los conocimientos del modelo, que están congelados en la fecha de su entrenamiento; las conexiones a bases de datos técnicas, que ayudan a responder a preguntas muy específicas; y las que podemos llamar herramientas de acción, con las que no solo se trata de leer, sino de hacer. El modelo puede conectarse a tu calendario para ver si estás libre o incluso enlazar con sistemas de pago para finalizar una reserva.

Es la diferencia entre que el chef te diga cómo se hace un suflé y que, efectivamente, ponga el horno a precalentar.

Para terminar con este apartado de la cocina, solo nos queda hablar de los guardrails, una especie de inspectores de sanidad. Los guardrails son los filtros de seguridad que aseguran que no estamos sirviendo comida en mal estado (respuestas tóxicas) ni revelando la receta secreta de la salsa (fugas de datos protegidos). Sin este inspector vigilando el pase, ninguna cocina debería estar abierta al público.

Haute cuisine

Si dejamos el menú del día y subimos al ático, encontramos la cocina experimental, la de vanguardia. Aquí ya no damos órdenes paso a paso; aquí gestionamos autonomía y especialización.

En este nivel nos encontramos a los agentes. Ya no estamos ante un pinche al que hay que vigilar, sino ante un chef autónomo al que das un objetivo y él solo se organiza.

El funcionamiento de un agente se basa en el ciclo iterativo ReAct (Reasoning + Acting). El agente descompone el objetivo en pasos lógicos (razona), ejecuta acciones concretas como llamadas a herramientas o APIs (actúa) y analiza los resultados obtenidos (observa). Si el resultado no cumple el criterio de éxito, el agente ajusta su estrategia y repite el bucle de forma autónoma hasta alcanzar la solución final.

El problema es que, en ocasiones, el objetivo puede ser demasiada tarea para un agente solo. En estos casos podemos recurrir a la brigada completa: los sistemas multiagente, a nivel de estrella Michelin.

Técnicamente, hablamos de arquitecturas de orquestación multiagente, en sistemas donde distintas instancias de IA especializadas interactúan para resolver tareas complejas. Por ejemplo, un agente «investigador» extrae datos de fuentes primarias, un agente «redactor» estructura el contenido y un agente «crítico» evalúa la coherencia y alucinaciones del borrador. A través de bucles de colaboración y debate, estos sistemas refinan el resultado final de forma autónoma, superando las limitaciones de un único LLM generalista.

Pero hay ocasiones en las que ni el mejor libro de recetas y ni el mejor equipo de pinches son suficientes. Si queremos que el chef no solo siga instrucciones, sino que respire su estilo culinario, necesitamos el último recurso de alta cocina del que vamos a hablar hoy: el fine-tuning. El objetivo ya no es que consulte un manual externo, sino enviarle a un curso intensivo para que interiorice sus técnicas hasta que formen parte de su «memoria muscular», cocinando sus platos casi por instinto.

Volviendo al campo de la IA, el fine-tuning (ajuste fino) consiste en retomar un modelo base pre-entrenado y someterlo a una fase adicional de aprendizaje supervisado, utilizando un conjunto de datos específico del dominio que nos interese (como protocolos clínicos propios o los códigos de la empresa).

A diferencia del RAG, que trabaja sobre la memoria temporal (el contexto que se recupera y se suma al prompt), el fine-tuning modifica permanentemente los pesos y parámetros de la red neuronal. Esto permite «fijar» el conocimiento o un comportamiento específico directamente en la estructura del modelo, logrando una especialización y eficiencia que sería imposible conseguir solo mediante prompts.

En la figura anterior podéis ver, de forma esquemática, estos componentes esenciales para el funcionamiento de las herramientas de IA.

Nos vamos…

Y con esto vamos a ir terminando este tour gastronómico.

En este recorrido por los fogones digitales hemos despiezado algunos de los elementos más críticos que hacen funcionar las herramientas de IA actuales, desde los ingredientes básicos indispensables, como los prompts que inician la comanda, los embeddings que definen el mapa de sabores y los LLM que actúan como jefes de cocina, hasta las técnicas de preparación más sofisticadas, como el uso de RAG y bases de datos vectoriales para gestionar la memoria, o el despliegue de agentes autónomos y el fine-tuning para lograr la excelencia culinaria.

Es importante comprender que la verdadera magia de la IA no reside en un ingrediente aislado, sino en su coordinación perfecta.

Imaginad el proceso: cuando lanzamos una consulta compleja al sistema, a menudo un agente autónomo toma el mando, corre a la despensa organizada de la base de datos vectorial para recuperar la receta exacta mediante RAG, consulta herramientas externas para validar datos en tiempo real y, solo entonces, deja que el modelo (quizás especializado previamente mediante fine-tuning) cocine la respuesta final bajo la atenta mirada de los inspectores de sanidad (guardrails). Es una coreografía técnica donde la memoria, la acción y la seguridad se unen para servir el plato perfecto sin que el comensal note el caos de la cocina.

Y ahora sí que, de verdad, nos vamos. En esta entrada nos hemos centrado en herramientas de respuesta ágil, pero hemos dejado de lado todo lo referente a las nuevas técnicas de los LLM razonadores, útiles cuando la intuición no basta y se requiere lógica pura. Estos modelos son sistemas diseñados para no responder al instante, sino que dedican tiempo de cómputo a ‘pensar’, trazar planes y verificar sus propias hipótesis internamente antes de servir el resultado final. Pero esa es otra historia…

Excelente enseñanza fundamentada en las metáforas

Gracias Carlos, me alegra que te haya gustado

Genial. Ameno e instructivo.

Muchas gracias Javier.